L’Ai al servizio dell’uomo

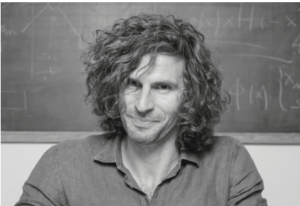

L’intelligenza artificiale (Ai) è un tema più che mai presente su tutti i media. Oggetto di approfondimenti e confronti, è diventata un argomento di cui tanti parlano, non sempre con cognizione di causa, e spesso con clamore. Be Private ha incontrato Fabio Ferrari, fondatore di Ammagamma Srl, una società giovane che offre soluzioni di intelligenza artificiale, chiedendogli di raccontare il suo progetto e il suo punto di vista su questa tecnologia.

L’intelligenza artificiale (Ai) è un tema più che mai presente su tutti i media. Oggetto di approfondimenti e confronti, è diventata un argomento di cui tanti parlano, non sempre con cognizione di causa, e spesso con clamore. Be Private ha incontrato Fabio Ferrari, fondatore di Ammagamma Srl, una società giovane che offre soluzioni di intelligenza artificiale, chiedendogli di raccontare il suo progetto e il suo punto di vista su questa tecnologia.

Ci racconta chi sono Fabio Ferrari e Ammagamma?

«Tutto è nato 10 anni fa, quando ho deciso di licenziarmi dall’università dove stavo facendo un dottorato di ricerca. La scelta è nata dalla volontà di portare la matematica nel mondo reale, nello specifico nelle aziende, per cercare di aiutare le persone che lavorano con processi fisici transazionali. L’obiettivo era raccogliere una serie di dati, conoscerli per elaborare un progetto di ottimizzazione che potesse offrire strumenti agli utenti finali per migliorare la loro attività. È da questa idea che è nata Ammagamma, una società di 110 professionisti, tra matematici, ingegneri e fisici, che vivono in un ex-convento nel centro di Modena e che cercano di studiare i dati dai quali estrarre informazioni e predizioni».

Come sono stati gli inizi?

«All’inizio parlavamo, oltre che di matematica, anche di intelligenza artificiale, tema quest’ultimo che, allora, nessuno capiva e generava molto scetticismo. Nell’arco di un decennio, la situazione si è completamente capovolta: l’argomento è più che mai dibattuto e presente sui media, in alcuni casi anche in modo eccessivo. L’esordio non è stato agevole, ma le difficoltà sono state mitigate dalle imprese del territorio che, proprio per il loro spirito di artigianalità e di voglia di sperimentazione e per la loro passione, ci hanno dato fiducia e offerto la possibilità di realizzare alcune delle nostre proposte. Abbiamo così iniziato a collaborare con le aziende manifatturiere che ci facevano lavorare su tutto ciò che era ausiliario alla produzione, come i sistemi ad aria compressa o l’organizzazione delle persone. Per usare una metafora, ci concedevano di giocare con i dadi, ma non ci lasciavano essere partecipi dei processi. Si trattava di investimenti in ambito puramente intellettuale per migliorare le procedure anche fisiche, ma senza cambiare nulla: la comprensione del loro meccanismo di funzionamento ci permetteva di produrre una ricetta di regolazione tramite logaritmi matematici da noi sviluppati. Con il passare del tempo, le società hanno potuto vedere i risultati del nostro lavoro e comprendere che l’utilizzo dell’Ai poteva essere molto utile per la loro crescita e ciò ci ha permesso di entrare nel cuore delle attività delle aziende in diversi ambiti: logistica, finanza, design e programmazione della produzione».

Un passo importante…

«Sì, perché abbiamo visto che la matematica può supportare l’esperienza delle persone, cosa che, del resto, ha sempre fatto, perché è una materia che aiuta a conoscere la natura che ci circonda. Negli ultimi anni, invece, abbiamo assistito a un’Ai raccontata in modo molto distorto, con scenari di algoritmi che autoimparano, cognitivi, che ruberanno posti di lavoro. Devo dire che, di fronte a questa evoluzione, siamo rimasti un po’ disorientati, perché sottrarre il lavoro all’uomo non è il ruolo della matematica, che viene invece utilizzata dall’individuo per indagare l’universo. È un racconto che non ci piace. Inoltre, si è notato che, alla luce di questa confusione anche mediatica, non solo è fondamentale portare uno strumento tecnologico all’interno di un’impresa, ma anche una forma mentis. Abbiamo così iniziato a creare, in Ammagamma, alcuni piccoli dipartimenti di scienze umane e di education per aiutare i nostri interlocutori a comprendere come leggere i dati e le informazioni. È stato un ulteriore passo importante che ci ha permesso di trovare una nuova italianità, perché la tecnologia che noi usiamo viene sviluppata principalmente negli Usa o in Asia e le culture a essa associate sono spesso americana o cinese. La prima è più orientata al business, mentre la seconda è più coercitiva e di controllo. Manca, al momento, una lettura dell’Ai in un contesto culturale italiano, europeo e, nel nostro piccolo, abbiamo cercato di essere interpreti di questa esigenza: utilizzare questa nuova applicazione tecnologica rendendola più sensibile, facendo in modo che le persone partecipino attivamente allo strumento e possano svilupparne una lettura critica. Si tratta di un aspetto fondamentale, perché significa che i risultati o le informazioni che ne derivano possono essere interpretati con la giusta comprensione e distanza dalla stessa tecnologia. Questo approccio ci ha permesso di trovare l’artigianalità italiana anche all’interno dell’Ai: in fondo, l’artigiano è colui che prende un oggetto e lo trasforma rendendolo bello, piacevole, comprensibile e accessibile. È stato importante vedere negli anni la crescente fiducia che le aziende ci hanno dato, probabilmente perché hanno visto in noi persone che non solo possono permettere l’accesso a nuove applicazioni tecnologiche, ma sono in grado di spiegare come ci si relaziona a esse».

Le aziende mostrano diffidenza nei confronti dell’Ai?

«Tuttora incontriamo società che vogliono esplorare il mondo dell’intelligenza artificiale, ma mostrano molta cautela. Noi, con alcuni nostri clienti, abbiamo compiuto passi importanti che hanno introdotto cambiamenti significativi, o in determinate business unit, o nell’impresa nel suo complesso, non solo da un punto di vista quantitativo, ma anche qualitativo nell’approccio adottato, che ha prodotto un cambiamento dell’atteggiamento mentale».

L’introduzione dell’Ai all’interno delle imprese è stata legata anche al raggiungimento di obiettivi di sostenibilità?

«Sì, spesso, perché abbiamo visto quanto l’intelligenza artificiale possa essere di supporto nel diminuire il livello di emissioni nell’atmosfera, di spreco, di utilizzo delle materie prime: è un alleato sul fronte della sostenibilità. Attenzione, l’Ai è anche uno strumento geopolitico e lo si può vedere all’interno di ambiti specifici come, ad esempio, l’agricoltura in Europa, perché il suo impiego nella gestione dei campi e nella selezione dei semi può avere un impatto importante i cui effetti non sono trascurabili».

Quindi, come si devono interpretare i commenti che vedono nell’Ai anche una minaccia per il mondo del lavoro?

«Penso che sia un grande equivoco e che nasca da un’errata interpretazione della matematica. Sino a oggi, l’uomo ha sempre ragionato in modo deterministico, cioè davanti a informazioni, dati e osservazioni ha riprodotto la natura che lo circonda. È un processo che ingaggia chiunque, perché permette, passaggio dopo passaggio, di ricostruire il mondo in cui si vive e si opera in modo logico e spiegabile. Ma ecco che arriva un nuovo tipo di matematica, quella utilizzata nell’Ai, che ha un approccio stocastico: dai dati e dalle informazioni estrae direttamente in modo probabilistico la soluzione, senza passaggi intermedi, come avviene con il metodo deterministico, e non ingaggia nessuno. Diventa così più difficile rendere partecipi del processo chi ne deve usufruire. Davanti a questa complessità, è certamente stato più facile per le grandi aziende raccontare l’intelligenza artificiale come qualcosa di cognitivo, che autoimpara. Tuttavia, siamo di fronte a una grande semplificazione che sulle persone può avere un effetto di meraviglia o di paura, ma si tratta di due reazioni estreme. L’Ai è algebra, ci sono dei numeri: l’unica differenza è che, proprio per quanto appena detto, risulta comprensibile a una nicchia più ristretta di persone, perché sono necessarie competenze specifiche. Credo che la confusione intorno all’Ai sia generata da questa asimmetria nella quale si contrappongono i due approcci: deterministico verso stocastico. Gli esseri umani non perderanno tutti il posto di lavoro, né saranno sovrastati dagli algoritmi, perché è l’uomo che sviluppa gli algoritmi che genera, che seleziona e interpreta i dati. L’uomo è sempre presente nella filiera. È il metodo che cambia. Quello stocastico è più difficile e complesso da comprendere, ma bisogna cambiare ed evolversi. Ammagamma non è solo una realtà che propone soluzioni per risolvere i problemi, ma anche una nuova forma mentis».

Cosa pensa, quindi, quando vede sente o legge di scenari distopici legati all’impatto dell’Ai?

«Leggo commenti dove si parla di decine di migliaia di lavori persi, ma, per il momento, non ho visto in Italia qualcuno che non abbia più un impiego a causa dell’Ai; e collaboriamo con oltre 200 aziende. È possibile che non ci saranno più nuove assunzioni in determinati ambiti, dove le mansioni saranno svolte dagli algoritmi, ma nascerà la domanda di nuove figure professionali che sapranno interfacciarsi con questo nuovo modo di ragionare, oppure saranno le stesse persone all’interno dell’azienda che dovranno aggiornare e modificare il proprio modo di lavorare. Ciò che è veramente cambiato è la velocità con la quale le cose stanno avvenendo. Le innovazioni ci sono sempre state nella storia dell’uomo: prima avvenivano nell’arco di millenni, poi di secoli, di decenni e adesso è diventata una questione di mesi: è un cambiamento che probabilmente spaventa. L’accorciamento della scala temporale delle scadenze, rispetto alla capacità di acquisire nello stesso tempo nuove competenze è il vero problema. Io, però, non sono un futurologo e non posso sapere che cosa accadrà domani, ma c’è una serie di previsioni che mi lasciano perplesso perché, un anno fa, una famosa azienda che fa analisi nel settore tecnologico non prendeva neppure in considerazione l’Ai tra le tecnologie più dirompenti».

ChatGpt è da temere?

«Dobbiamo avere paura delle risposte sbagliate che ci dà e quindi stare molto attenti a non assumerle per scontate. Non dobbiamo temere ChatGpt oggi, ma guardare con grande attenzione agli elementi tecnologici con cui è costruita perché, se un domani fosse calata all’interno di un’azienda e diventasse un sistema operativo, allora penso che si dovrebbe guardare a questa evoluzione con attenzione. Essa, infatti, potrebbe permettere a qualsiasi interlocutore di comunicare direttamente con l’impresa, con effetti che potrebbero essere importanti».

Considera l’Ai una “nuova rivoluzione industriale”?

«Non lo so, faccio molta fatica a esprimere un giudizio. Noto che l’Ai più evoluta è utilizzata nel settore della guida delle auto autonome, mentre in Ammagamma vediamo tante applicazioni che sono molto fattive nell’azienda: previsione dell’acquisto delle materie prime, organizzazione della forza lavoro, programmazione delle campagne di comunicazione, strutturazione della logistica. Io mi auguro che alcuni obiettivi che i grandi player del settore annunciano siano alla fine realizzabili e producano vere e proprie rivoluzioni. Cambierà, ad esempio, la capacità diagnostica e miglioreranno i servizi sanitari? Sarebbe bellissimo se, grazie a pochi dati a disposizione, fosse possibile prevenire diverse patologie con diagnosi ottenute attraverso l’osservazione dell’iride. Per il momento, non vedo ancora questi progetti come tangibili, bensì noto molte cose effimere che vengono incanalate nei social network e alimentano anche le fake news. Ed è un peccato, perché in questo modo si distolgono gli sforzi da ciò che potrebbe fare la differenza, ad esempio nella gestione di un’azienda, nella medicina, nell’agricoltura e nel modo di distribuire la ricchezza».

I più importanti player dell’Ai sono veri e propri colossi. Lo vede come un rischio?

«Sono giganti che hanno mezzi finanziari e hanno tutto l’interesse a fare campagne di comunicazione a loro piacimento: sono Google, Microsoft, Meta, che investono ingenti capitali in startup, dietro le quali ci sono interessi mostruosi. Sono aziende monopoliste che hanno le risorse per spingere i propri strumenti e possono permettersi di cambiare l’opinione pubblica. Oggi vediamo tre realtà. Ci sono i big della tecnologia che ci parlano del futuro, della fantascienza che si avvera. Poi c’è la tecnologia disponibile, credibile, fattiva e che cresce a una velocità esponenziale e, infine, ci sono aziende, perlomeno in Italia, che faticano a usare un foglio di Excel. Sono tre mondi che coesistono, tra di loro lontani e spiace che un paese come l’Italia sia in ritardo, in questo ambito, rispetto ai suoi pari in Europa».

Parlando d’Italia, pensa che il ritardo sia un problema culturale, di sistema scolastico o altro?

«Il dominio tecnologico ed economico delle grandi aziende del tech non può non avere degli influssi sull’Europa e ciò è chiaramente visibile. Ma non ci sono solo le società americane, basterebbe pensare alla cinese Tik Tok, che ha avuto un’amplissima diffusione tra il pubblico dei giovanissimi. Siamo già schiacciati, quindi, da culture che non affondano le loro radici nella nostra storia. Penso che il Vecchio continente abbia oramai perso la battaglia tecnologica nei confronti di Stati Uniti e Cina, ma la grande risorsa che abbiamo a disposizione è la nostra cultura, italiana ed europea, arricchita dai classici greci e romani e dai valori della democrazia, dalla trasparenza e dall’inclusione. Avere tolto la matematica e la fisica da tutte le altre discipline delle scienze umane è stata una grande perdita, perché abbiamo tagliato una parte del patrimonio che ci apparteneva. Ciò che ora possiamo fare è applicare il nostro approccio culturale a questa nuova tecnologia, che potrebbe prendere in contropiede tutti: potremmo elaborare un nostro modo di utilizzo e di applicazione. Purtroppo, ciò che vedo, è che si sta scimmiottando quanto avviene nei due opposti del mondo».

Quindi più materie Stem a scuola?

«No, perché la formazione dell’essere umano non può essere relegata solo a questo ambito. Occorre avere una diversa consapevolezza e comprendere che un paese non può investire solo nella tecnologia senza farlo anche nella cultura, altrimenti il rischio è un impoverimento, sia dei valori, sia dei modelli che vengono presi ad esempio da imitare. Dobbiamo evitare di diventare robot impregnati di culture diverse dalla nostra».

Rimane l’annoso problema di fondo: la tecnologia non è neutrale. È d’accordo?

«Quella di cui stiamo parlando non è una tecnologia neutrale, perché, dal mio punto di vista, veicola già un pensiero. E poi c’è un altro aspetto da tenere presente: se l’Ai diventasse veramente così pervasiva, non avrebbe, a mio parere, un effetto neutrale sull’uomo. e non si tratta di una considerazione manichea tra bene e male. Fino a oggi l’essere umano ha robotizzato le linee di produzione, demandando alle macchine le sue capacità fisiche, ma ora iniziamo a farlo anche per quelle computazionali e cognitive. Se gli studenti non faranno più compiti di matematica perché li delegheranno a ChatGpt, se le decisioni saranno prese da un algoritmo, vuole dire che si è dinnanzi a un’evoluzione che avrà diversi impatti sull’uomo. È un tema molto importante, del quale non si parla, e penso che proprio su questo aspetto l’Europa potrebbe farsi portatrice di un confronto e aprire un dibattito perché, come menzionato, ha gli strumenti storici culturali che gli altri paesi non hanno, anche se sono potenze economiche».

C’è un’etica dell’Ai?

«Si parla tanto di etica legata all’intelligenza artificiale, tema discusso da molti filosofi. Non voglio entrare nel dibattito, ma essendo un appassionato di fisica, ho elaborato la seguente riflessione: c’è un’etica molto più basica che è quella intrinseca nella scienza, che è il metodo scientifico. Significa avere trasparenza nei dati, nel loro utilizzo e nell’analisi dei risultati. Si fanno alcune supposizioni, si crea un passaggio per avvalorare la tesi, la si rende pubblica affinché chiunque possa confutarla e, se non viene confutata, allora è valida. È un problema di metodo grazie al quale è possibile un confronto».

Occorre una regolamentazione?

«Quando è stata conclusa la prima parte della redazione dell’Ai Act, per regolamentare l’uso dell’intelligenza artificiale in Europa, le reazioni dei rappresentanti dei singoli paesi sono state tutte positive, corali nei toni di approvazione del risultato conseguito, tranne quella del presidente della Francia. Macron che, anziché delegare a un messaggio via social il suo pensiero, ha convocato una conferenza stampa per esprimere il suo disappunto su una decisione che l’Europa sta prendendo da sola, come se fosse un’isola, senza negoziare con gli altri attori del mercato, i giganti della tecnologia. Io ritengo che per regolamentare l’Ai si debba seguire il modello utilizzato dall’Ocse quando ha deciso sulla tassazione a livello mondiale di operare super partes, offrendosi come arbitro sul tema».